Modelle

- Seedance 2.0BeliebtNeu

- Veo 3.1 PremiumBeliebt

- GPT Image 2Neu

- Nano Banana 2Beliebt

- Seedream 5.0 Lite

- Z-Image Turbo

- Grok Imagine Bild

Laden...

Laden...

Verstehen Sie zuerst die Positionierung aller drei Veo-3.1-Versionen und öffnen Sie dann die Modellseite, die am besten zu Ihrer aktuellen kreativen Phase, Ihrem Budget und Ihrem Ausgabenziel passt: Veo 3.1 ist die Flaggschiff-Qualitätsstufe, Fast ist die Variante mit dem besten Preis-Leistungs-Verhältnis und Lite ist für hochvolumige Batch-Generierung ausgelegt.

Google Veo ist eine KI-Videomodellfamilie von Google DeepMind, entwickelt für stärkeres Prompt-Verständnis, hochwertigere visuelle Ergebnisse und flexible Text-zu-Video- sowie Bild-zu-Video-Workflows. Auf AnyAIHub können Sie Veo-Modellversionen vergleichen und den passenden Weg für Kurzvideos, Werbemittel, visuelle Konzepte, Produktanimationen und Brand Storytelling wählen.

Diese Seite funktioniert am besten als Überblick über die Veo-Modellfamilie auf AnyAIHub. Die stärkste Positionierung liegt bei hochwertiger KI-Videogenerierung, besserem Prompt-Verständnis und praktischen Bild-zu-Video-Workflows.

Veo wurde für hochwertigere Videoausgabe entwickelt und eignet sich daher besser für Projekte, die mehr visuelle Veredelung, stärkere Shot-Präsentation und ein insgesamt fertigeres Ergebnis benötigen. Ob Brand Films, Social-First-Konzepte oder Produktvideos: Ausgabequalität ist einer der klarsten Gründe, Veo auf AnyAIHub einzusetzen.

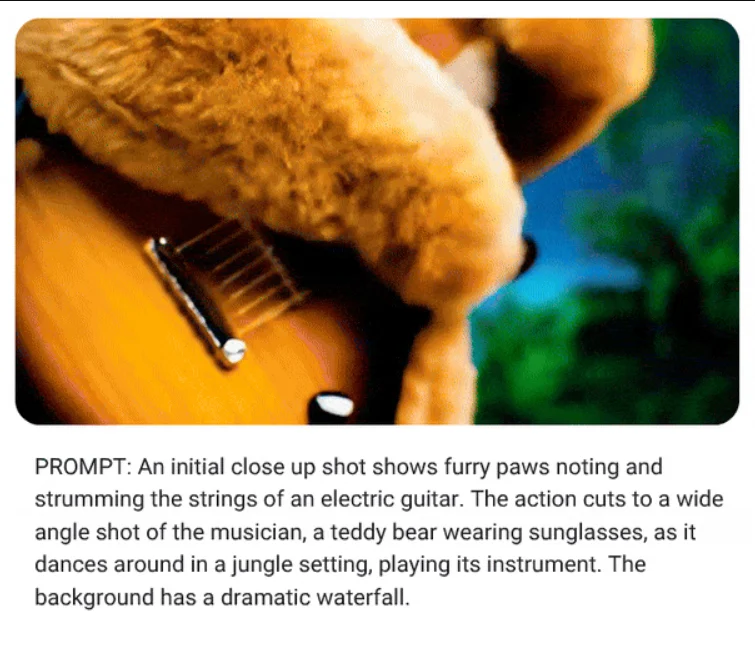

Veo verarbeitet natürlich formulierte Prompts deutlich besser, was es stabiler bei komplexen Szenenbeschreibungen, Kameraintentionen, Aktionsfolgen und emotionaler Tonalität macht. Für Creator bedeutet das, dass keine starren, parameterlastigen Prompts nötig sind, um Videoergebnisse zu erhalten, die näher an der ursprünglichen Absicht liegen.

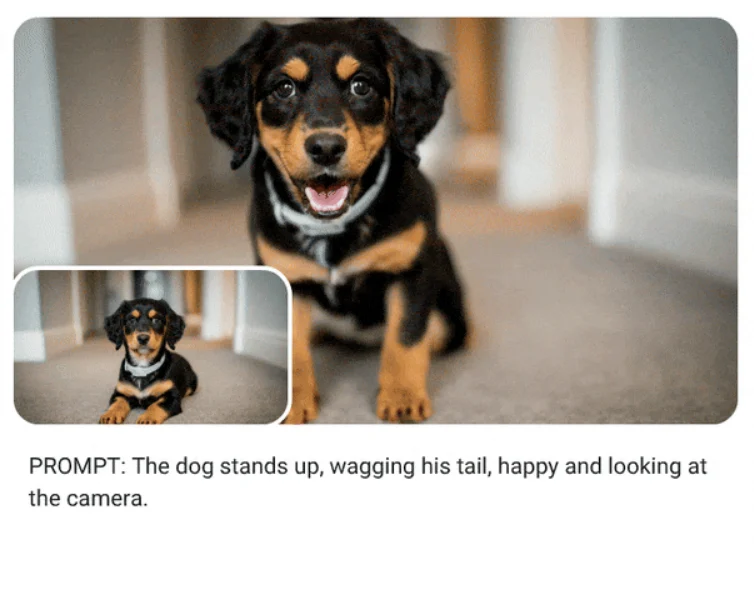

Veo eignet sich auch sehr gut für Bild-zu-Video-Workflows. Sie können von einem Charakterbild, einem Produktfoto oder einem Kampagnen-Key-Visual ausgehen und ein statisches Asset in Bewegung überführen. Für Projekte mit animierten Brand Assets, Produktvideo-Varianten oder stärkerer visueller Konsistenz ist dies auf AnyAIHub oft der praktischere Workflow.

Wählen Sie zuerst das passende Veo-Modell, geben Sie dann einen Prompt oder ein Referenzbild ein und generieren sowie prüfen Sie anschließend das Ergebnis. Für die meisten Nutzer auf AnyAIHub ist die richtige Modellwahl am Anfang wichtiger, als früh zu viele Effektbeschreibungen zu stapeln.

Wählen Sie Lite, Fast oder die Flaggschiff-Qualitätsstufe je nach Ziel. Lite eignet sich besser für hochvolumige Batch-Generierung und kostengünstige Tests, Fast für schnelle Iteration mit solidem Preis-Leistungs-Verhältnis und starker visueller Qualität, und Veo 3.1 für finale Auslieferung und maximale Bildqualität.

Sie können einen Prompt direkt schreiben, um ein Video zu erzeugen, oder in einem Bild-zu-Video-Workflow ein Referenzbild hochladen. In der Regel hilft es, Szene, Motiv, Aktion, Kameraführung und Gesamtstimmung klar zu beschreiben, statt sich nur auf abstrakte Stilwörter zu verlassen.

Prüfen Sie nach der Generierung zuerst, ob Kameraintention, Motivverhalten und Gesamt-Timing funktionieren, und entscheiden Sie dann, ob Sie zu einer höherwertigen Version wechseln oder den Prompt weiter verfeinern. Die Richtung zuerst zu validieren und den Feinschliff danach zu verfolgen, ist meist der bessere Produktionsweg.

Diese FAQs helfen Nutzern zu verstehen, was Google Veo ist, wie es sich von anderen KI-Videomodellen unterscheidet, welche Workflows es unterstützt und wie man die passende Veo-Version auf AnyAIHub auswählt.

Veo ist Googles KI-Videomodellfamilie von Google DeepMind und wurde erstmals im Mai 2024 öffentlich vorgestellt. Die Kernpositionierung liegt in stärkerer visueller Qualität, besserem Prompt-Verständnis und einer besseren Bild-zu-Video-Fähigkeit, um Nutzern effizienter bei der Generierung von Videos aus Text oder Bildern zu helfen.

Im Vergleich zu vielen Videomodellen, die sich vor allem auf die Geschwindigkeit eines einzelnen Durchlaufs konzentrieren, fällt Veo stärker durch hochwertigere Bildqualität, natürliches Sprachverständnis und eine Ausgabe auf, die sich näher an echter Kameralogik anfühlt. Das macht es attraktiver für Projekte, die Wert auf Politur, Konsistenz und feinere Prompt-Reaktion legen.

Ja. Veo unterstützt sowohl direkte Text-zu-Video-Generierung als auch Bild-zu-Video-Workflows, die von einem Standbild ausgehen. Welche Eingabemethoden tatsächlich verfügbar sind, hängt jedoch von der jeweiligen Veo-Seite und den aktuell auf AnyAIHub freigeschalteten Formularfähigkeiten ab.

Weil diese Seite besser als Einstiegspunkt in die Veo-Modellfamilie funktioniert. Sie hilft Nutzern zuerst, die Positionierung der verschiedenen Versionen zu verstehen, und leitet sie dann zu spezifischeren Veo-Unterseiten auf AnyAIHub weiter. Das ist klarer, als jede Version und jede Fähigkeit in eine überladene Einzelseite zu pressen.

Es eignet sich für kreative Kurzformate, Werbekonzepte, visuelle Markeninhalte, Produktvideos, bildgetriebene Motion Pieces und Storyboard-Vorschauen. Besonders nützlich ist es, wenn ein Projekt auf visuelle Qualität Wert legt, aber gleichzeitig KI nutzen will, um die Exploration zu beschleunigen.

Ausgehend von Googles öffentlicher Positionierung konzentriert sich Veo auf hochwertige Videogenerierung und HD-Ausgabe. Die tatsächliche Dauer, Auflösung und der Funktionszugang variieren jedoch je nach Plattform, Integrationsweg und Modellversion. Deshalb sollten sich die finalen Erwartungen immer nach der konkreten Veo-Seite und dem verwendeten Formular auf AnyAIHub richten.

Wählen Sie Lite, wenn Sie die kosteneffizienteste Option für hochvolumige Batch-Generierung, frühe Konzeptvalidierung und breite Entwurfsprüfung brauchen. Wählen Sie Fast, wenn Sie das beste Preis-Leistungs-Verhältnis für schnelle Iteration und Variantentests suchen und dabei eine starke visuelle Qualität behalten wollen. Wählen Sie Veo 3.1, wenn das Projekt in die finale Auslieferung geht und Sie das Flaggschiffmodell mit der höchsten Bildqualität brauchen. Die richtige Stufe zuerst zu wählen, ist meist effektiver, als den Prompt zu überladen.

Eine hilfreiche Struktur ist Szene + Motiv + Aktion + Kamera + Stimmung. Statt sich nur auf abstrakte Stilbegriffe zu verlassen, führt die klarere Beschreibung von Motiv, Bewegungsänderungen, Kameraführung und emotionaler Tonalität meist zu stabileren Ergebnissen auf AnyAIHub.

Vergleichen Sie zuerst die Veo-Modellversionen und wählen Sie dann den Workflow, der zu Ihrer aktuellen Projektphase passt. Auf AnyAIHub führen eine klarere Modellpositionierung und präzisere Prompts in der Regel zu besseren Ergebnissen als generische Marketingversprechen.