Modelle

- Seedance 2.0BeliebtNeu

- Veo 3.1 PremiumBeliebt

- GPT Image 2Neu

- Nano Banana 2Beliebt

- Seedream 5.0 Lite

- Z-Image Turbo

- Grok Imagine Bild

Laden...

Laden...

Seedance 2.0 wurde für stärkere strukturelle Kontrolle und höhere kreative Präzision entwickelt. Es kann Videos erzeugen, indem es Text, Bilder, Videoclips und Audio als Referenzen kombiniert. Der Schwerpunkt liegt auf Figuren- und Objektkonsistenz, realistischeren physikalischen Bewegungen und vollständiger Kontrolle von kreativer Replikation bis hin zur Vorwärts- und Rückwärtsverlängerung von Videos. Damit eignet es sich besonders für Teams und Kreative, die einen professionelleren Workflow für die Videogenerierung wollen.

Seedance 2.0 konzentriert sich auf multimodale Referenzen, realistische Bewegung, visuelle Konsistenz, kreative Replikation, Storyboard-Verständnis und nahtlose Videoverlängerung.

Durch das Hochladen kombinierter Assets wie Figurenbilder, Hintergrundvideos oder Audiospuren kann Seedance 2.0 diese deutlich präziser zusammenführen. Das Modell versteht, welche Details aus den Referenzmaterialien erhalten bleiben sollen, von der Lichtstimmung bis zu komplexen Figurenbewegungen, und überträgt sie genauer in das finale Video.

Version 2.0 verbessert Bewegung und physikalische Realitätsnähe deutlich. Von fließendem Wasser bis zu Haarbewegungen wirkt jedes dynamische Detail stabiler, flüssiger und glaubwürdiger. Selbst ohne komplexe Referenzen können einfache Text-zu-Video-Ergebnisse wesentlich ausgefeilter und professioneller aussehen.

Ein häufiges Problem bei KI-Videos ist das Driftverhalten zwischen Einstellungen. Seedance 2.0 begegnet dem, indem wichtige Elemente fixiert werden. So bleiben Details von Produktetiketten bis zu Kleidungseigenschaften über den gesamten Clip hinweg besser erhalten, während Flackern und unerwünschte Verformungen reduziert werden.

Seedance 2.0 kann Tempo und Struktur eines Referenzvideos nachbilden und erkennt Kamerasprache, Übergänge und visuelle Organisation. So kannst du professionellere Videoausdrücke nachstellen, ohne dich auf komplexe Produktionsbegriffe stützen zu müssen.

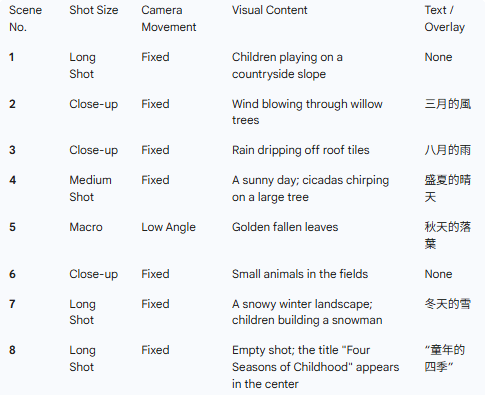

Seedance 2.0 verfügt über ein tieferes Verständnis von Erzählfluss und Szenenlogik. Es erzeugt nicht nur isolierte Clips, sondern kann Einstellungen auf Basis komplexer Storyboards und detaillierter Prompts organisieren und so Ergebnisse liefern, die näher an einer vollständigen Erzählsequenz liegen.

Mit der verbesserten Videoverlängerung kann Seedance 2.0 vorhandenes Material analysieren und eine natürliche Fortsetzung erzeugen. Egal, ob du vor einem Moment mehr Kontext hinzufügen oder eine Szene nach ihrem Höhepunkt verlängern willst, das Modell bewahrt Umgebungs- und Figurenkontinuität deutlich besser.

Von der kreativen Eingabe über die Parametereinstellung bis hin zu KI-Generierung und finalem Export bietet Seedance 2.0 einen vollständigeren Workflow für die Videogenerierung.

Gib einen detaillierten Prompt ein oder lade ein Referenzbild in Seedance 2.0 hoch. Du kannst Figuren, Szenen, Kamerawinkel und Bewegung beschreiben, damit das Modell eher auf Regieebene formulierte Anweisungen versteht und präzisere Bildkompositionen erzeugt.

Wähle die passende Auflösung, das Seitenverhältnis und die Videolänge. Seedance 2.0 bietet flexiblere Ausgabesteuerungen, damit du Plattformanforderungen und kreative Ziele besser abgleichen kannst.

Lass Seedance 2.0 das Ergebnis generieren. Das Modell erzeugt hochauflösende Videoframes mit realistischeren Bewegungen, kohärenteren Sequenzen aus mehreren Einstellungen und einem vollständigeren End-to-End-Workflow.

Sieh dir das generierte Ergebnis in der Vorschau an und lade eine sofort nutzbare MP4-Datei herunter. Das Video kann auf sozialen Plattformen geteilt oder in deinen professionellen Produktions-Workflow übernommen werden.

Diese Fragen und Antworten wurden von der Seedance-2.0-Seite übernommen und konzentrieren sich auf multimodale Referenzen, Konsistenz, kommerzielle Nutzung, Videobearbeitung, physikalische Realitätsnähe und Storyboard-Verständnis.

Seedance 2.0 zeichnet sich durch seine Fähigkeit zu multimodalen Referenzen aus. Während viele Modelle hauptsächlich Text oder ein einzelnes Bild akzeptieren, kann es auch Video und Audio lesen, um bestimmte Bewegungen, Rhythmen und Stile zu replizieren. Dadurch erhalten Kreative ein höheres Maß an Kontrolle.

Das Modell nutzt eine stärkere raumzeitliche Logik, um Figuren und Umgebungen stabil zu halten und so Drift bei Gesichtern, Kleidung und Hintergrunddetails von Frame zu Frame zu reduzieren. Dadurch eignet es sich besser für professionelle Storytelling-Workflows, die starke Konsistenz erfordern.

Ja. Es kann Produktdetails bewahren und gleichzeitig hochwertige Schnittstile wie Übergänge und Kamerabewegungen replizieren. Damit eignet es sich gut für professionellen Marketing-Content, Markenwerbung und Produktdemos.

Ja. Du kannst ein Referenzvideo hochladen und es mit Text-Prompts kombinieren, um Stil, Figuren oder Szenen zu verändern, während die ursprüngliche Bewegung und Kamerasprache so weit wie möglich erhalten bleiben. Dadurch eignet es sich für Video-zu-Video-Stilerzeugung.

Die Seite betont ein stärkeres physikalisches Verständnis, wodurch das Modell reale Dynamiken wie Schwerkraft, Reibung, Flüssigkeitsbewegung und Objektinteraktion besser verarbeiten kann. Dadurch wirken Haarbewegungen, fließendes Wasser und physischer Kontakt gewichtiger und glaubwürdiger.

Bidirektionale Verlängerung bedeutet, dass du einen Clip nach vorne fortsetzen oder ergänzen kannst, was davor passiert ist. So lässt sich ein vollständigerer Erzählkontext aufbauen, während Umwelt-, Figuren- und Kamerakontinuität möglichst gut erhalten bleiben.

Ja. Du kannst ein Standbild einer Figur oder eines Produkts hochladen und dann ein separates Videoreferenzmaterial angeben, damit das Modell Bewegungsstil oder Kamerarhythmus lernt und dieses dynamische Verhalten auf das statische Motiv anwendet, während die ursprünglichen visuellen Details erhalten bleiben.

Seedance 2.0 verfügt über ein stärkeres Verständnis von Skripten und Storyboards und kann strukturierte Drehbücher oder Storyboard-Bilder interpretieren, während es Kamerawinkel, Lichtstimmung und Erzählentwicklung versteht. Dadurch eignet es sich besser für Mehrfachsequenzen, die an professionelle Film-Workflows angelehnt sind.

Wenn du Text-, Bild-, Video- und Audioreferenzen in einem professionelleren Video-Workflow kombinieren und mehr Kontrolle über Konsistenz, Bewegungsqualität und Videoverlängerung gewinnen möchtest, starte mit Seedance 2.0.